Dalle regole al comportamento: come l’Intelligenza Artificiale può rafforzare la tutela dei giocatori

Uno degli aspetti più rilevanti introdotti dalla nuova concessione online riguarda l’implementazione, da parte dei concessionari, di sistemi di analisi comportamentale finalizzati a prevenire i rischi di gioco problematico. Si tratta di un passaggio importante, perché segna un possibile cambiamento di paradigma: dalla gestione del rischio fondata su misure statiche e generaliste a un approccio dinamico, costruito sull’osservazione dei comportamenti effettivi del singolo giocatore.

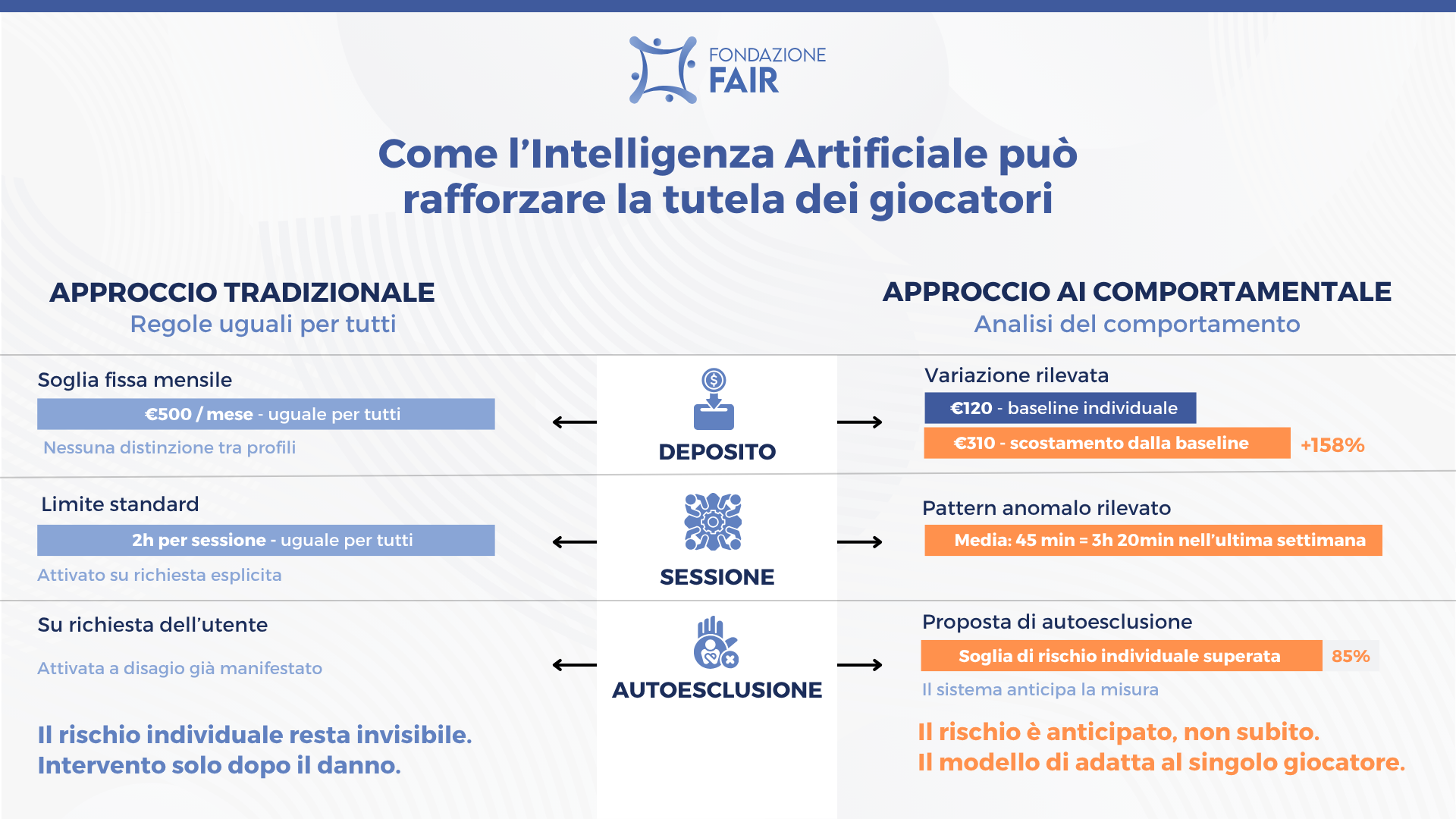

Fino a oggi, la gran parte delle misure di gioco responsabile si è basata su strumenti per loro natura standardizzati: limiti di deposito, limiti di tempo o di spesa, autoesclusione, messaggi informativi tendenzialmente uguali per tutti. Si tratta di presìdi necessari, che rappresentano una base minima di tutela, ma che mostrano anche limiti evidenti. In particolare, intervengono spesso in modo uniforme su platee molto diverse tra loro e, non di rado, si attivano quando i segnali di rischio sono già emersi con una certa evidenza.

L’introduzione di modelli di analisi comportamentale consente invece di spostare il focus sul giocatore come individuo, osservato nel proprio percorso di gioco e non soltanto ricondotto a soglie standard o a valori medi. In questo senso, l’Intelligenza Artificiale può rappresentare un fattore di evoluzione decisivo. Attraverso la capacità di elaborare grandi volumi di dati, questi sistemi possono rilevare variazioni anche minime nei comportamenti di gioco — ad esempio nella frequenza delle sessioni, nella durata, nei depositi, nella spesa o nella ricorrenza del gioco in specifiche fasce orarie — permettendo di individuare precocemente situazioni meritevoli di attenzione.

Il punto di forza di questo approccio non risiede soltanto nella capacità predittiva, ma nella possibilità di costruire interventi più tempestivi, proporzionati e personalizzati. Non più, dunque, una tutela indistinta, ma un insieme di azioni calibrate sul profilo comportamentale del singolo giocatore. In questa prospettiva, anche logiche di nudging ben progettate possono contribuire ad aumentare l’efficacia delle misure di gioco consapevole: un alert contestualizzato, una richiesta di riflessione sul proprio comportamento, la proposta di impostare un limite volontario o una pausa temporanea possono risultare molto più incisivi di un messaggio generico.

La vera innovazione, quindi, è la possibilità di intervenire prima che il comportamento diventi apertamente problematico. Un’analisi tradizionale fatica a cogliere segnali deboli o cambiamenti graduali; un sistema comportamentale avanzato, invece, può riconoscere discontinuità che meritano attenzione anche quando non hanno ancora superato soglie formalmente critiche. Si pensi, per esempio, a un giocatore che, nell’arco di poche settimane, aumenti la frequenza delle sessioni notturne, modifichi in modo repentino i propri livelli di spesa e mostri una crescente tendenza a rivedere verso l’alto i limiti che in precedenza aveva impostato volontariamente. Nessuno di questi segnali, preso singolarmente, equivale necessariamente a una condizione di problematicità; ma la loro combinazione può rappresentare un campanello d’allarme rilevante, rispetto al quale un intervento “soft” e tempestivo può avere un valore preventivo concreto.

Questi modelli possono diventare ancora più robusti se alimentati anche da evidenze provenienti dalla ricerca scientifica e dall’utilizzo di scale psicologiche e strumenti di valutazione del rischio, come il PGSI, capaci di arricchire la lettura dei comportamenti osservati. In altri termini, la tecnologia produce il massimo valore quando non si limita a classificare eventi, ma dialoga con la conoscenza maturata sul piano psicologico, comportamentale e sociale. Tuttavia, proprio qui emerge la questione più delicata. La stessa tecnologia che può essere utilizzata per proteggere il giocatore può anche essere orientata in direzione opposta: aumentare il valore del cliente, intensificare l’engagement, massimizzare la monetizzazione. È questo il vero nodo strategico e regolatorio.

L’AI, di per sé, non è né protettiva né dannosa: dipende dagli obiettivi che le vengono assegnati, dalle metriche che guidano i modelli e dalla governance entro cui viene utilizzata. Per questa ragione, non è sufficiente affermare che il settore adotterà strumenti più avanzati. Occorre chiarire chi decide quando intervenire, sulla base di quali indicatori, con quali priorità e sotto quale controllo. Se i modelli vengono progettati in un contesto in cui prevale esclusivamente la logica di valore economico del giocatore, il rischio di ambiguità è evidente. Se invece vengono inseriti in un quadro di regole condivise, metriche comuni e principi di trasparenza, l’AI può diventare uno strumento di tutela realmente evoluto.

Da questo punto di vista, sarà centrale definire linee guida regolatorie condivise sull’uso di questi sistemi, stabilire criteri omogenei per l’identificazione dei profili di rischio e introdurre forme di accountability capaci di verificare non solo l’esistenza degli strumenti, ma anche il loro impatto effettivo. Il tema non è solo tecnologico: è di governance, di equilibrio tra interessi diversi e, in ultima analisi, di responsabilità verso il giocatore.

È proprio qui che si colloca, a nostro avviso, il bivio più importante per il settore. L’evoluzione in corso può limitarsi ad aggiungere nuovi adempimenti tecnologici a un impianto già esistente, oppure può contribuire a trasformare il gioco responsabile da obbligo normativo a leva di sostenibilità industriale, reputazionale e sociale. La differenza tra questi due esiti dipenderà dalla capacità di adottare una visione coerente: usare la tecnologia non solo per rendere più efficiente il business, ma per rendere più maturo, trasparente e responsabile l’intero sistema. In questa transizione, sarà fondamentale promuovere un approccio che metta al centro evidenza scientifica, trasparenza metodologica e misurazione dell’impatto. È su questo terreno che il gioco responsabile può compiere un salto di qualità reale: non come insieme di misure formali, ma come sistema evoluto di protezione dei giocatori.

L’Intelligenza Artificiale può rappresentare una straordinaria opportunità, ma solo a condizione che il suo utilizzo sia orientato con chiarezza alla tutela della persona. Per questo, oggi più che mai, serve una convergenza tra regolatore, operatori e stakeholders istituzionali, affinché l’innovazione tecnologica diventi uno strumento di responsabilità e non soltanto di efficienza.

Iscriviti alla newsletter e rimani aggiornato sulla Fondazione FAIR